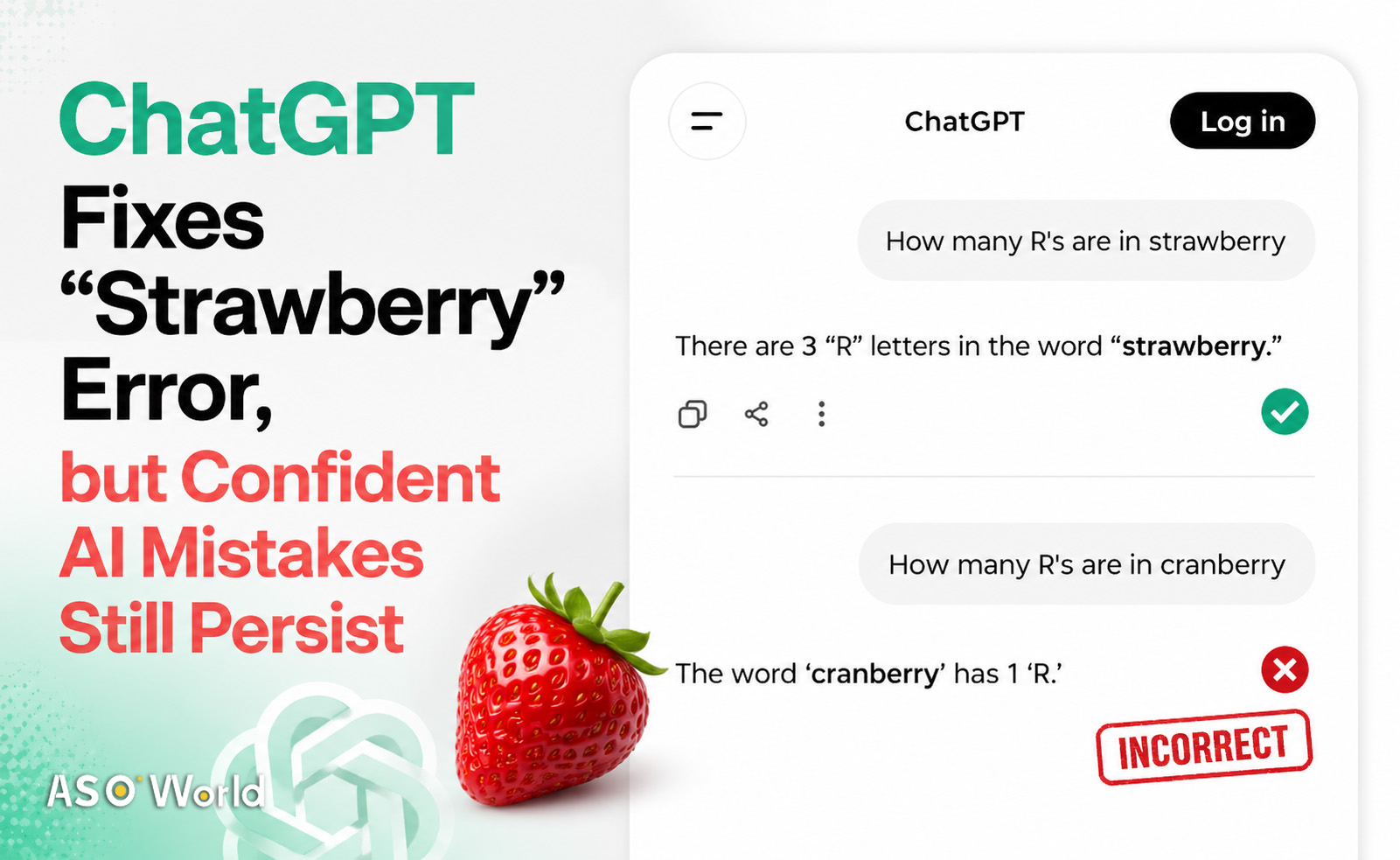

OpenAI は最近、ChatGPT がかつて話題となった質問――「strawberry」に含まれる「R」の数――に正しく答えられるようになったと発表しました。

このアップデートは一見些細に見えますが、それを巡る広範な議論は、AIシステムが依然として自信を持って誤った回答を生成するという重大な問題を改めて浮き彫りにしました。AIツールへの依存を強めているアプリ開発者、グロースチーム、投資家にとって、これは信頼性、正確性、意思決定に関する実務的な懸念を提起しています。

業界の注目を集めたバイラル修正

「strawberry」のカウント誤りは、AIの限界を示す代表的な事例となりました。数か月にわたり、ChatGPTは「R」の数を誤って数え、しばしばその誤答を擁護していました。

この問題が修正されたというOpenAIの最近の発表は、テックおよび開発者コミュニティで急速に広まり、モデル挙動の段階的な進歩を示すものとなりました。

なぜ単なるバグ以上の意味を持つのか

この修正は些細に見えるかもしれませんが、より広範な期待を示しています。つまり、AIツールは基本的な論理を確実に扱えるべきだということです。

検索、レコメンデーション、アプリ内アシスタントなど、ユーザー向け機能にAIを統合するプロダクトチームにとって、たとえ小さな不正確さであっても、ユーザーの信頼やリテンション指標に直接影響を与える可能性があります。

依然として残る「自信満々の誤り」という中核的リスク

改善が進んでいるとはいえ、AIモデルは依然として「自信満々の誤り」を示します。つまり、高い確信を持って誤った出力を提供するのです。この挙動は、グロースやオペレーションの文脈において特に問題となります。

アプリストア最適化と成長への影響

ASO担当者やマーケティングチームは、次の用途でAIをますます活用しています:

- キーワード調査およびメタデータ生成

- 広告コピーおよびクリエイティブのテスト

- ユーザーレビュー分析および感情インサイト

AIの出力が不正確であっても信頼できるように見える場合、チームは次のリスクを負います:

- 効果の薄いキーワードをターゲットにすること

- ユーザーフィードバックを誤解すること

- 不適切な最適化判断を下すこと

時間の経過とともに、これらの誤りはランキング、コンバージョン率、そして全体的なオーガニック成長に悪影響を及ぼす可能性があります。

ハードコードされた修正 vs. スケーラブルなAI信頼性

ChatGPTは現在「strawberry」の質問に正しく答えますが、「cranberry」の文字数を数えるなど類似のプロンプトでは、依然として一貫しない結果が生じます。これは、一部の修正がより深い推論能力の向上ではなく、ハードコードによる対応である可能性を示唆しています。

AI統合におけるプロダクト上の示唆

AI搭載機能を構築する開発者にとって、ここで重要なのは次の区別です:

- 表面的な正確性: 特定のテストケースに合格すること

- 体系的な信頼性: 多様な入力に対して一貫したパフォーマンスを発揮すること

検証レイヤーなしでAIに依存すると、特に自動化の多いワークフローにおいて、プロダクト体験に潜在的なリスクを持ち込む可能性があります。

開発者にとっての意味

開発者は、アプリにAIを統合する際にガードレール、検証ロジック、フォールバック機構を実装すべきです。文字数の誤カウントのような一見小さなエラーであっても、ユーザー向けの問題へと連鎖し、機能の信頼性やアプリの成長に影響を及ぼす可能性があります。

異なる入力に対して一貫したAIパフォーマンスを確保することは、ユーザーの信頼を維持し、高品質な体験を提供するうえで不可欠です。この出来事は、AIの成熟度が単なる能力だけでなく、実世界のユースケースにおける正確性と信頼性によって測られることを強調しています。

コメント

「strawberry」の修正は、文字を数えること以上に、AIが依然としてどこで限界を抱えているかを示すシグナルです。アプリを構築または拡張するチームにとっての真の教訓は明確です。AIは成長を加速させることができますが、適切な監督がなければ、静かな非効率を招く可能性も同様にあります。

AIに関するその他の記事:

FAQs

1. なぜこのChatGPTのアップデートはアプリ開発者にとって重要なのですか?

AI搭載機能、ユーザー体験、プロダクトの信頼に影響を与える可能性のある信頼性の問題を浮き彫りにしているためです。

2. AIの誤りはASOやマーケティング成果にどのような影響を与えますか?

不正確なインサイトは、不適切なキーワード選定、弱いクリエイティブ、コンバージョン率の低下につながる可能性があります。

3. これらのAIのエラーは完全に解決されていますか?

いいえ、異なる文脈では同様の問題が依然として見られ、より深い制限があることを示しています。

4. チームは成長ワークフローでAIをどのように安全に活用すべきですか?

AIの出力を人間のレビュー、検証システム、パフォーマンス監視と組み合わせることによってです。