Google ResearchとDeepMindは、差分プライバシー(DP)を採用し、機密データを保護しながら高いパフォーマンスを維持する10億パラメータのAIモデル、VaultGemmaをリリースしました。

このオープンソースの画期的なモデルは、大規模言語モデル(LLM)におけるデータ漏洩の懸念に対応し、医療や金融などの業界向けに安全なソリューションを提供します。

プライバシー重視のAIの新時代

VaultGemmaは、GoogleのGemma 2アーキテクチャを基盤に構築され、差分プライバシーを根本から組み込み、トレーニングデータの安全性を確保します。

従来のLLMとは異なり、敵対的プロンプトによる機密情報の暴露リスクを防ぐ設計で、VaultGemmaはデータの記憶を防止し、倫理的なAI開発のゲームチェンジャーとなります。

VaultGemmaの特徴

VaultGemmaは、26層のデコーダ専用トランスフォーマーで、Multi-Query Attentionを備え、Gemma 2と同じデータで事前トレーニングされています。

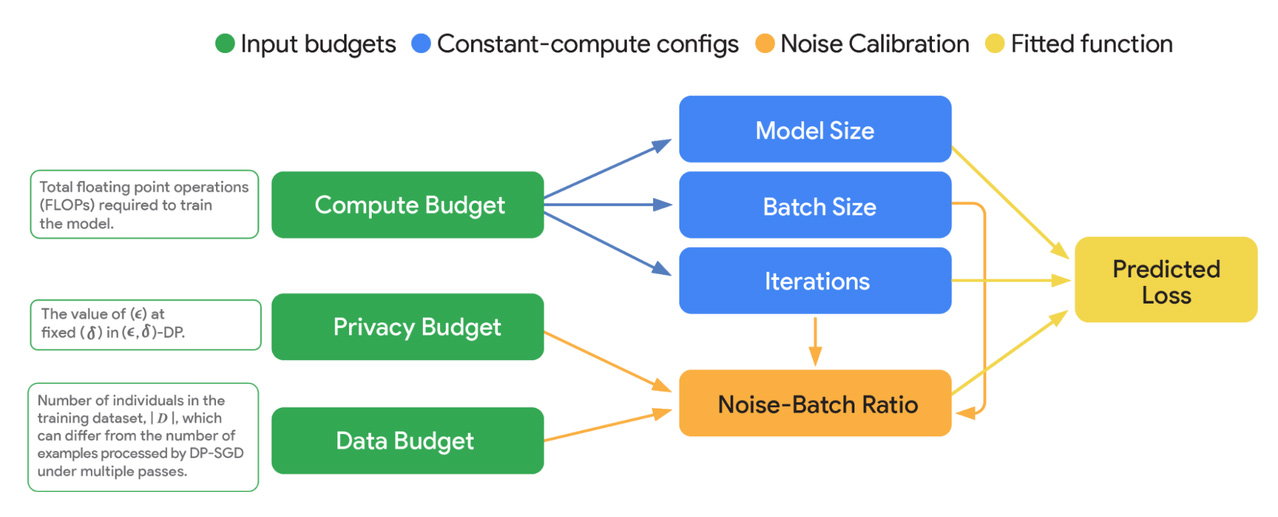

差分プライバシーは、勾配クリッピングとガウスノイズメカニズムを通じてノイズを追加する差分プライバシー確率的勾配降下法(DP-SGD)によって実現されます。

これにより、最大1,024トークンのシーケンスに対してプライバシー保証(ε ≤ 2.0、δ ≤ 1.1e−10)が確保され、特定のデータの有無にかかわらず出力が統計的に区別できないことが保証されます。

GoogleのTPUv6eハードウェア上でJAXとML Pathwaysを使用してトレーニングされ、ベクトル化クリッピングや大規模バッチサイズなどの最適化により、DPの計算負荷を軽減し効率を維持します。

パフォーマンスとプライバシーのバランス

差分プライバシーはパフォーマンスにトレードオフをもたらしますが、VaultGemmaはGPT-2(15億パラメータ)などの非プライバシーモデルと同等の性能を発揮します。

ベンチマークでは、MMLU推論タスクで約45%を達成し、Gemma 3 1Bの52%にはやや劣りますが、データ漏洩が検出されないという決定的な利点があります。これは機密性の高いアプリケーションにとって重要です。

ベンチマークの洞察

Googleの研究「差分プライバシー言語モデルのスケーリング法則」では、計算量、プライバシーバジェット、モデルサイズがパフォーマンスにどのように影響するかを説明しています。

VaultGemmaは、Big-Bench Hardなどのタスクで古い非DPモデルと競合しますが、依然として性能のギャップが存在します。

DP技術の進展により、このギャップはさらに縮小し、モデルの汎用性が向上する可能性があります。

実世界の応用とアクセシビリティ

VaultGemmaのプライバシー優先設計は、規制の厳しい業界に最適です。

医療分野では、患者データを安全に分析でき、金融分野では、ユーザー情報を危険にさらさずに詐欺検出を強化できます。

Hugging FaceやKaggleなどのプラットフォームで利用可能で、GPU、TPU、CPUをサポートしますが、Google Colabの無料枠のような小規模システムではリソースの要求が課題となる場合があります。

コミュニティと業界への影響

業界のリーダーたちは、VaultGemmaを「安全なAI革命」と称賛し、特にそのオープンソースでの提供を高く評価しています。

ソーシャルメディアでの議論では、規制業界での可能性に熱意が示される一方、一部のユーザーはハードウェアの制約を指摘しています。

そのリリースは、Googleの責任あるAIへの取り組みを強調し、プライバシー保護モデルの基準を確立します。

編集者のコメント

VaultGemmaは、LLMが長年抱えてきたデータプライバシーの重要なギャップに対処し、倫理的なAIへの重要な一歩を表します。

そのオープンソース性は、安全なAIへのアクセスを民主化し、機密性の高い領域でのイノベーションを促進します。

しかし、パフォーマンスのトレードオフは、プライバシーと実用性のバランスという大きな課題を浮き彫りにします。

DP技術が進化するにつれて、将来のモデルはこのギャップを縮め、規制業界でのAI展開を再構築する可能性があります。

Googleが技術的詳細や重みを公開する透明性は高い基準を設けますが、小規模な開発者向けにリソース需要の最適化が普及の鍵となるかもしれません。

このリリースは、競合他社がプライバシーを優先するきっかけとなり、より安全なAIシステムへの競争を加速させる可能性があります。

よくある質問

VaultGemmaとは何ですか?

VaultGemmaは、Googleが開発した10億パラメータのAIモデルで、差分プライバシーを採用し、トレーニングデータを保護しながらパフォーマンスを維持します。

VaultGemmaの差分プライバシーはどのように機能しますか?

DP-SGDを使用し、勾配クリッピングとガウスノイズメカニズムを通じてノイズを追加することで、出力が特定のトレーニングデータを明らかにしないようにします。

VaultGemmaは他のAIモデルとどう比較されますか?

GPT-2などの古い非DPモデルと同等ですが、非プライバシーのGemma 3 1Bにはやや劣ります。ただし、データ漏洩がゼロという利点があります。

開発者はVaultGemmaをどこで利用できますか?

Hugging FaceやKaggleで利用可能で、GPU、TPU、CPU環境をサポートします。

VaultGemmaの応用例は?

プライバシーが重要な医療、金融、教育分野での安全なデータ分析に最適です。

パフォーマンスのギャップがある理由は?

差分プライバシーはノイズを追加するため、非プライバシーモデルに比べて精度が若干低下しますが、最適化によりこのギャップは縮小しつつあります。

VaultGemmaはGoogle Colabなどの無料プラットフォームで動作しますか?

リソース需要が高いため、無料枠の能力を超える可能性があり、TPUや高性能GPUなどの強力なハードウェアが必要です。

VaultGemmaはAI倫理にどのように影響しますか?

データ漏洩の懸念に対処し、規制業界での安全な展開を可能にするプライバシー優先のAIの基準を設けます。