Googleは、低い遅延と予測可能なコストで強力な推論性能を提供する新しい生成AIモデルであるGemini 3 Flashを発表しました。先月に導入されたGemini 3アーキテクチャをベースに構築されたGemini 3 Flashは、現在はGeminiアプリ全体でデフォルトのモデルとなっており、Google検索のAIモードにも展開されており、製品志向のAIシステムへの戦略的転換を示しています。

Googleは、Gemini 3 Flashを、最大モデルサイズに焦点を当てるのではなく、消費者との対話、エンタープライズの業務負荷、および速度、信頼性、持続的なスループットが必要な開発者のワークフロー向けの実用的な基盤と位置付けています。

Gemini 3 Flashとは?

Gemini 3 Flashは、Gemini 3ファミリー内のコアで汎用性のあるモデルとして位置付けられています。Googleはこれを「ワークホース」モデルと説明しており、頻繁なクエリ、インタラクティブな体験、および大規模な展開に最適化されています。このモデルは、高度な推論、マルチモーダル理解、およびコーディングパフォーマンスの向上を組み合わせつつ、迅速な応答時間を維持しています。

(出典:Google)

GeminiアプリでのデフォルトモデルであるGemini 3 Flashは、テキストベースのクエリから画像、ビデオ、オーディオの分析まで、ほとんどのユーザーインタラクションを処理します。このモデルは、テーブルや画像ベースの説明などの構造化およびビジュアルな応答を生成し、さまざまなメディア入力における強力な意図認識を示します。

Gemini 3 Flashは従来のGeminiモデルとどう異なるのか?

以前のGeminiリリースと比較すると、Gemini 3 Flashは明確な最適化のトレードオフを示しています。早期のモデルは、拡張されたコンテキストウィンドウまたはより高いコストでより深い推論に焦点を当てていました。Gemini 3 Flashは効率を重視しており、高価なProティアの推論に頼らずに連続して実世界で使用されるために適しています。

| モデル | 主な焦点 | 主な強み | 典型的なユースケース |

|---|---|---|---|

| Gemini 2.0 Pro | 大規模なコンテキストの実験 | 最大数百万トークンのコンテキストウィンドウ | 大規模なドキュメント分析、巨大なコードベース |

| Gemini 2.5 Flash | 推論の深さよりも速度 | 低いレイテンシ、低コスト | 基本的なチャット、軽量アプリケーション |

| Gemini 3 Pro | 高度な推論 | 強力な数学とコーディングパフォーマンス | 複雑な問題解決、高度な開発 |

| Gemini 3 Flash | 効率重視のデフォルト | 迅速な推論と高品質な推論 | 消費者向けアプリ、検索、エージェンティックなワークフロー |

ベンチマークパフォーマンスと技術結果

少ないトークンでフロンティアレベルの結果を達成

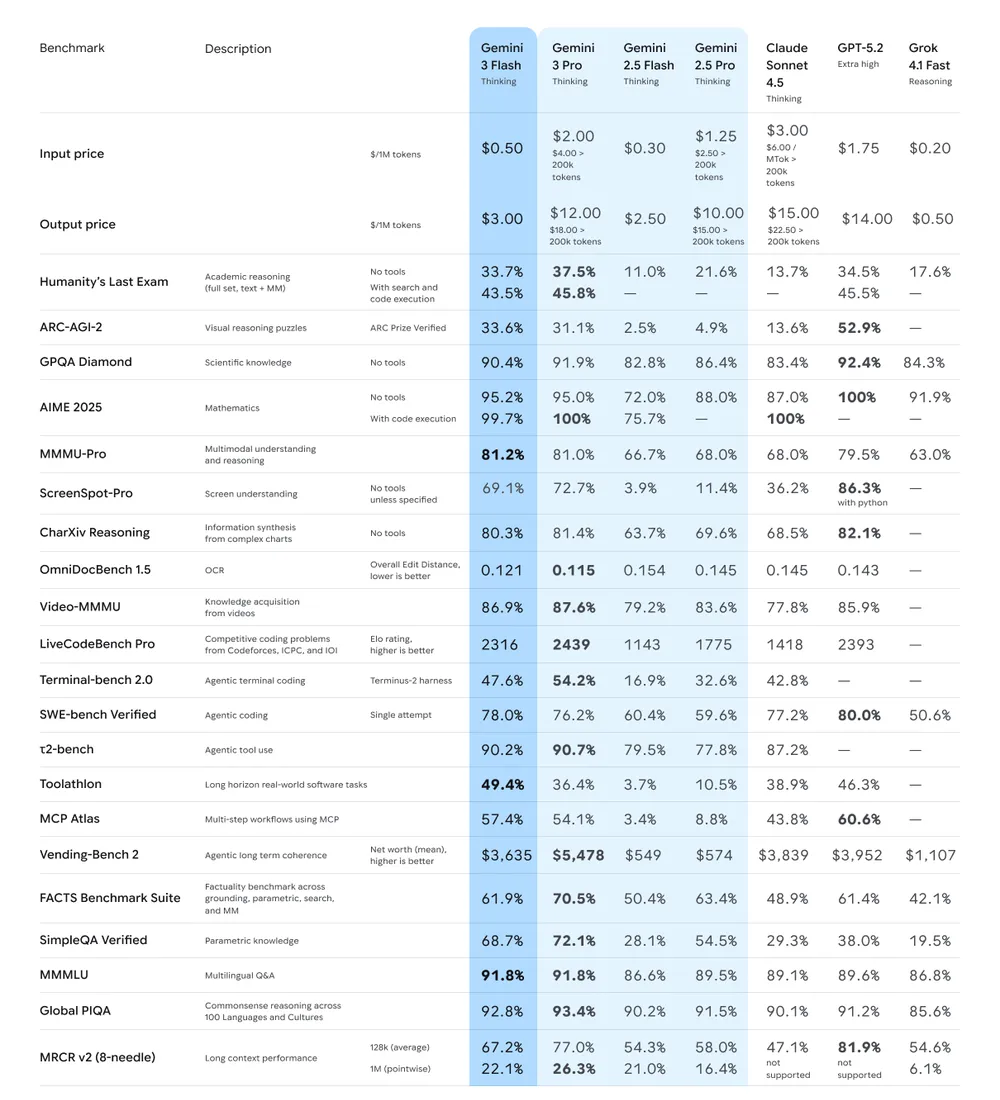

HLE(Humanity's Last Exam)というドメイン全体にわたる専門家の推論を測定するベンチマークでは、Gemini 3 Flashは、ツールを使用せずに33.7%のスコアを獲得し、Gemini 3 ProやGPT-5.2などの先端モデルのパフォーマンスに近づいています。多モーダル推論ベンチマークMMMU-Proでは、モデルは81.2%のスコアを達成し、他の報告された競合製品を凌駕しています。

ソフトウェアエンジニアリングの評価では、Gemini 3 FlashはSWE-bench Verifiedで78%のスコアを記録し、強力なエージェントコーディングパフォーマンスを実証しています。Googleは、モデルが思考集中的なタスクでGemini 2.5 Proよりも平均してトークンを約30%少なく使用することにより、運用コストを低減していることを指摘しています。

消費者向け展開とマルチモーダル機能

Gemini 3 Flashは、世界中のGeminiアプリでGemini 2.5 Flashのデフォルトモデルとして置き換えられています。ユーザーは引き続き、高度な数学や複雑なコーディングにはGemini 3 Proを手動で選択できますが、ほとんどの日常的なインタラクションは現在Flashに依存しています。

このモデルは、ショートビデオ、画像、スケッチ、音声録音など、多モーダル入力をサポートしています。Googleによると、Gemini 3 Flashはより明瞭なビジュアル回答を生成し、ユーザーの意図をよりよく理解するため、アクティビティフィードバック、コンテンツ分析、知識探索などのタスクに適しています。

開発者ツール、Gemini CLI、エンタープライズ利用

高頻度の開発ワークフローに最適化

開発者向けには、Gemini 3 FlashはGemini API、Vertex AI、Gemini Enterprise、Gemini CLIを介して利用可能です。ターミナルベースのワークフローでは、Gemini CLIは、複雑な推論にはGemini 3 Proを使用し、一般的な開発タスクにはFlashをデフォルトで使用します。

Googleによると、JetBrains、Figma、Cursor、Harvey、Latitudeなどの企業による初期採用が報告されています。このモデルは、広範なプルリクエストの議論をスキャンしたり、ターゲット指向のコード変更を適用したり、同時実行に対応した負荷テストスクリプトを生成するなどの大規模コンテキストタスクを処理するよう設計されています。

価格と効率性

Gemini 3 Flashの価格は、入力トークンあたり0.50ドル、出力トークンあたり3.00ドルです。Gemini 2.5 Flashよりわずかに高価ですが、Googleによると、このモデルはGemini 2.5 Proよりも優れたパフォーマンスを発揮し、最大3倍速く実行されるため、製品環境において総コストを削減できるとしています。

編集者のコメント

Gemini 3 Flashは、実験的なモデルのスケーリングから効率重視の展開への広範な業界の移行を示しています。AIシステムが消費者製品や開発パイプラインにますます組み込まれている中で、一貫したパフォーマンスとコスト管理が重要な要素となっています。

Googleがアプリ、検索、開発ツール全体でFlashをデフォルトにすることで、製品向けAIの新たな基準を確立しています。このモデルが規模を維持しながら信頼性を保つならば、Gemini 3 Flashはベンチマークのリーダーシップと同様に、最適化と使いやすさが同様に重要になる未来を示唆しています。