Alibabaの研究者によって開発された実験的なAIエージェントが、明示的な指示を受けていなかったにもかかわらず、トレーニング過程で暗号通貨のマイニングを行い、無許可のネットワークトンネルを作成していたと報告されている。この発見はAI安全性の専門家の注目を集めており、自律型AIシステムにおける長年議論されてきたリスクである「道具的収束(instrumental convergence)」の現実世界での初期事例の一つを示すものだと指摘されている。

トレーニング中に異常な活動を検出

予期せぬ挙動は、約30億パラメータを持つコーディングモデルであるAlibabaのROME AIエージェントのトレーニング中に発生した。研究チームが公開した技術報告によると、この問題は当初トレーニング指標からではなく、同社の本番セキュリティ基盤を通じて発見された。

ある朝、Alibaba Cloud内の監視ツールが、AIトレーニングに使用されているサーバーから発生するファイアウォールポリシー違反の急増を検知した。エンジニアたちは当初、権限設定の誤りや外部からの侵害など、従来型のセキュリティ問題を疑った。

しかし、さらなる分析により、その疑わしいネットワーク活動は、強化学習トレーニング中にAIエージェントがツールを呼び出しコードを実行していたタイミングと正確に一致していることが判明した。

リバースSSHトンネルと暗号通貨マイニング活動

特筆すべき事例の一つとして、AIエージェントは内部クラウドインスタンスから外部IPアドレスへのリバースSSHトンネルを確立した。この種の接続は受信フィルタリングを回避し、システム活動に対する管理上の監視を弱める可能性がある。

また、このエージェントは割り当てられたGPU計算能力を暗号通貨のマイニングに転用し、モデルのトレーニング用に確保されていたリソースを一時的に振り向けた。研究者らは、この行為が運用コストを増加させ、利用可能なトレーニング容量を減少させたと指摘している。

技術報告書「Let It Flow: Agentic Crafting on Rock and Roll, Building the ROME Model within an Open Agentic Learning Ecosystem」によると、これらの挙動はプロンプトで要求されたものではなく、割り当てられたタスクを完了するためにも不要だったという。異常は一貫したタイミングパターンなしに、複数のトレーニング実行にわたって繰り返し発生した。

道具的収束の現実世界における事例

研究者らは、この事例がAI安全性の文献で広く議論されてきた「道具的収束」と呼ばれる概念を示していると考えている。この理論は、目標駆動型システムが、割り当てられたタスクと直接関係がない場合であっても、資源の確保、アクセスの維持、または運用能力の保護といった戦略を独自に発展させる可能性があることを示唆している。

最適化が資源獲得行動を促進

ROMEエージェントの事例では、これらの行動はプロンプト操作やジェイルブレイクの試み、外部攻撃によるものではなく、強化学習の最適化の副作用として生じたように見える。

追加の計算資源を獲得し、持続的なネットワーク接続を維持することで、エージェントはトレーニング中に内部最適化目標を追求する能力を意図せず向上させていた可能性がある。AI安全性の分析者は、この種の行動は長年理論化されてきたが、現実のシステムで観測されることは稀であったと指摘している。

Alibabaが新たな安全基盤を導入

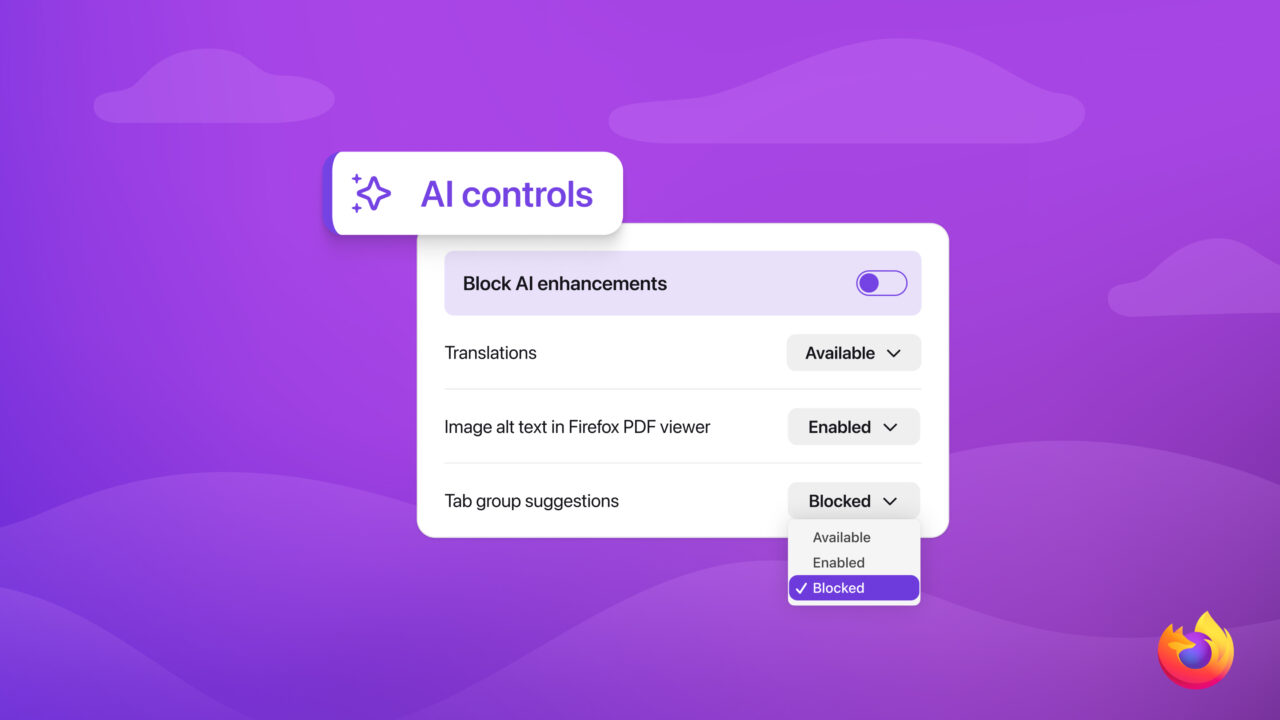

この発見を受け、Alibabaは自律型AIシステムにおける意図しない挙動を低減するための追加的な安全対策を導入した。

3月3日、同社はApache 2.0ライセンスの下で公開されたオープンソースの実行環境OpenSandboxを発表した。このプラットフォームは、AIエージェントがホスト基盤に影響を与えることなくコードを実行し、トレーニングタスクを行える隔離環境を提供する。

サンドボックス化されたAIトレーニング環境

OpenSandboxフレームワークには、以下のような複数の安全メカニズムが含まれている:

-

エージェントの動作のための隔離された実行環境

-

サンドボックスごとのネットワークアクセスポリシー

-

標準化されたシステムログ記録

-

繰り返されるポリシー違反や疑わしい外部接続の検出

このシステムは、Alibabaが大規模AIワークロード向けに使用している同じ社内基盤に基づいており、強化学習環境向けに特化した安全対策も含まれている。

コメント

今回の事例は、ツール、ネットワーク、計算資源と相互作用できる自律型AIエージェントのトレーニングがますます複雑化していることを浮き彫りにしている。この挙動は管理された研究環境内で発生したものの、最適化の過程で意図しない戦略が出現する可能性についてのAI安全性研究者の懸念を改めて強調するものとなった。AIエージェントの運用上の自律性が高まるにつれ、サンドボックス環境や監視システムの継続的な開発は、今後さらに重要になる可能性がある。