Google Research и DeepMind выпустили VaultGemma, модель ИИ с 1 миллиардом параметров, разработанную с использованием дифференциальной приватности (DP) для защиты конфиденциальных данных при сохранении высокой производительности.

Этот прорыв с открытым исходным кодом решает нарастающие проблемы утечки данных в больших языковых моделях (LLM), предлагая безопасное решение для таких отраслей, как здравоохранение и финансы.

Новая эра для ИИ, ориентированного на приватность

VaultGemma, построенная на архитектуре Google Gemma 2, интегрирует дифференциальную приватность с нуля, обеспечивая безопасность тренировочных данных.

В отличие от традиционных LLM, которые рискуют раскрыть конфиденциальную информацию через враждебные запросы, дизайн VaultGemma предотвращает запоминание данных, что делает её революционной для этичного развития ИИ.

Что делает VaultGemma уникальной?

VaultGemma — это трансформер только с декодером, состоящий из 26 слоёв и использующий Multi-Query Attention, предварительно обученный на тех же данных, что и Gemma 2.

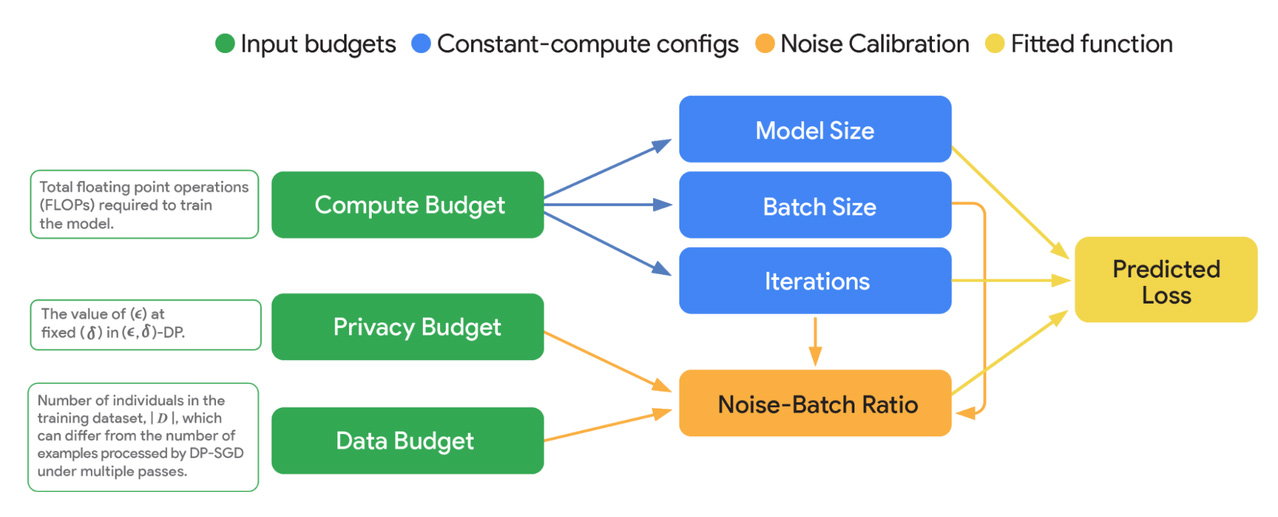

Дифференциальная приватность достигается за счёт стохастического градиентного спуска с дифференциальной приватностью (DP-SGD), который добавляет шум через ограничение градиентов и гауссовские механизмы.

Это обеспечивает гарантию приватности (ε ≤ 2.0, δ ≤ 1.1e−10 для последовательностей до 1,024 токенов), что означает, что выходные данные статистически неотличимы независимо от включения конкретных данных.

Обученная на оборудовании Google TPUv6e с использованием JAX и ML Pathways, модель использует оптимизации, такие как векторизованное ограничение и большие размеры пакетов, чтобы сохранить эффективность несмотря на высокие вычислительные требования DP.

Производительность и приватность: поиск баланса

Хотя дифференциальная приватность влечёт компромисс в производительности, VaultGemma показывает результаты, сравнимые с непроизводительными моделями, такими как GPT-2 (1.5 миллиарда параметров).

Тесты показывают, что она достигает ~45% на задачах рассуждения MMLU, что немного ниже 52% у Gemma 3 1B, но без обнаруживаемых утечек данных — критическое преимущество для конфиденциальных приложений.

Инсайты по тестам

Исследование Google «Законы масштабирования для языковых моделей с дифференциальной приватностью» описывает, как вычислительные ресурсы, бюджет приватности и размер модели влияют на производительность.

VaultGemma конкурирует со старыми моделями без DP в задачах, таких как Big-Bench Hard, но разрыв в полезности всё ещё сохраняется.

Продолжающиеся улучшения в технологиях DP могут ещё больше сократить этот разрыв, повышая универсальность модели.

Применение в реальном мире и доступность

Дизайн VaultGemma, ориентированный на приватность, делает её идеальной для регулируемых секторов.

В здравоохранении она может безопасно анализировать данные пациентов; в финансах — усиливать обнаружение мошенничества без ущерба для информации пользователей.

Доступна на платформах, таких как Hugging Face и Kaggle, она поддерживает использование GPU, TPU и CPU, хотя требования к ресурсам могут быть сложными для небольших систем, таких как бесплатный уровень Google Colab.

Влияние на сообщество и индустрию

Лидеры индустрии называют VaultGemma «революцией безопасного ИИ», особенно за её доступность с открытым исходным кодом.

Обсуждения в социальных сетях подчёркивают энтузиазм по поводу её потенциала в регулируемых отраслях, хотя некоторые пользователи отмечают ограничения оборудования.

Её выпуск подчёркивает приверженность Google ответственному ИИ, устанавливая стандарт для моделей, сохраняющих приватность.

Комментарии редактора

VaultGemma представляет собой ключевой шаг к этичному ИИ, решая критический пробел в приватности данных, который долгое время困扰ал LLM.

Её открытая природа демократизирует доступ к безопасному ИИ, способствуя инновациям в чувствительных областях.

Однако компромисс в производительности подчёркивает более широкую проблему: баланс между приватностью и полезностью.

По мере развития технологий DP будущие модели могут сократить этот разрыв, потенциально изменяя развертывание ИИ в регулируемых секторах.

Прозрачность Google в предоставлении технических деталей и весов устанавливает высокий стандарт, но широкое внедрение может зависеть от оптимизации требований к ресурсам для небольших разработчиков.

Этот релиз может подтолкнуть конкурентов к приоритизации приватности, ускоряя гонку к более безопасным системам ИИ.

Часто задаваемые вопросы

Что такое VaultGemma?

VaultGemma — это модель ИИ с 1 миллиардом параметров от Google, разработанная с дифференциальной приватностью для защиты тренировочных данных при сохранении производительности.

Как работает дифференциальная приватность в VaultGemma?

Она использует DP-SGD, добавляя шум через ограничение градиентов и гауссовские механизмы, чтобы выходные данные не раскрывали конкретные тренировочные данные.

Как VaultGemma сравнивается с другими моделями ИИ?

Она сопоставима со старыми моделями без DP, такими как GPT-2, но немного уступает непроизводительной Gemma 3 1B, с преимуществом нулевой утечки данных.

Где разработчики могут получить доступ к VaultGemma?

Она доступна на Hugging Face и Kaggle, поддерживает среды GPU, TPU и CPU.

Каковы области применения VaultGemma?

Она идеальна для безопасного анализа данных в здравоохранении, финансах и образовании, где приватность критична.

Почему существует разрыв в производительности?

Дифференциальная приватность добавляет шум, слегка снижая точность по сравнению с непроизводительными моделями, но оптимизации сокращают этот разрыв.

Может ли VaultGemma работать на бесплатных платформах, таких как Google Colab?

Её требования к ресурсам могут превышать возможности бесплатного уровня, требуя мощного оборудования, такого как TPU или высокопроизводительные GPU.

Как VaultGemma влияет на этику ИИ?

Она устанавливает стандарт для ИИ, ориентированного на приватность, решая проблемы утечки данных и обеспечивая безопасное развертывание в регулируемых отраслях.