애플은 다양한 장애를 가진 개인들을 위해 장치를 보다 사용자 친화적으로 만들기 위해 설계된 일련의 새로운 접근성 기능을 발표했습니다.

이러한 기능들은 Eye Tracking, Music Haptics, 그리고 Vocal Shortcuts를 포함하며, 올해 나중에 이용 가능할 예정입니다.

아이패드와 아이폰에 Eye Tracking이 도입됩니다

신체 장애에 대한 혁신적인 해결책

애플의 새로운 Eye Tracking 기능은 사용자가 눈만 사용하여 자신의 아이패드 또는 아이폰을 탐색할 수 있게 합니다.

이 기능은 전면 카메라와 장치 내 기계 학습을 활용하여 모든 데이터가 안전하고 개인 정보 보호되도록 합니다.

Eye Tracking은 추가 하드웨어 없이 iPadOS 및 iOS 앱에서 매끄럽게 작동합니다.

음악 Haptics가 음악 체험을 향상시킵니다

청각 장애인들을 위한 획기적인 기술

음악 Haptics는 iPhone의 Taptic Engine을 통해 청각 장애 또는 난청인 사용자들이 음악을 체험할 수 있는 새로운 방법을 제공합니다. 오디오를 촉각적인 감각으로 변환하여 이 기능은 음악을 더욱 접근 가능하고 즐겁게 만듭니다.

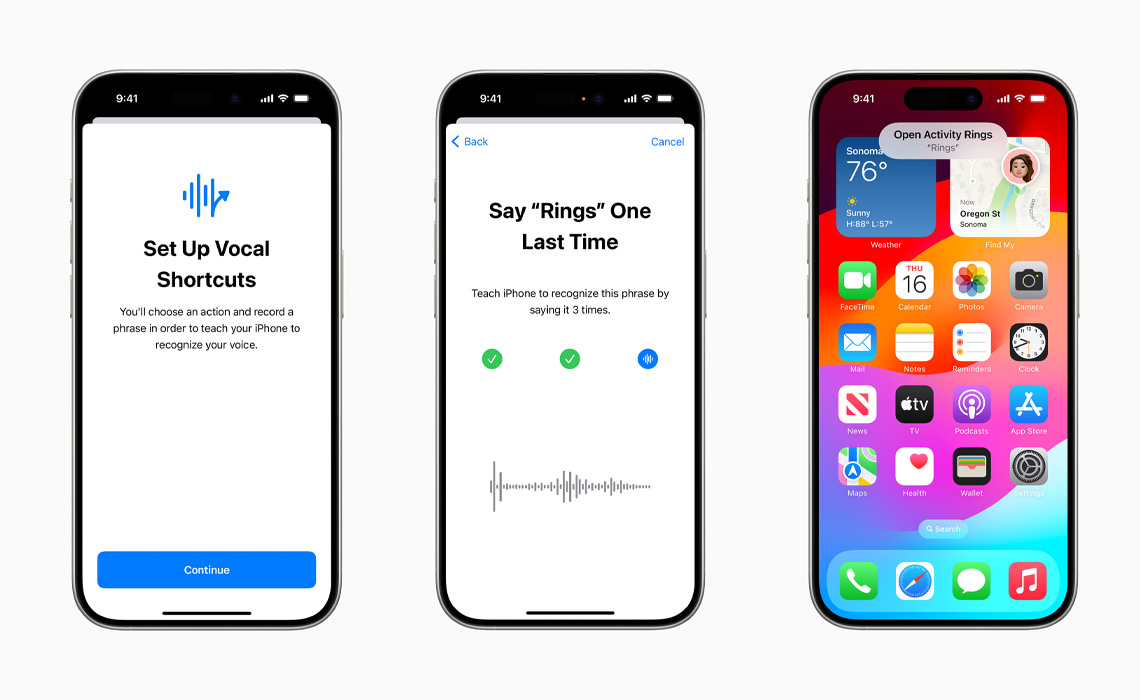

Vocal Shortcuts와 음성 인식

사용자 지정 발언 및 비정상적인 발음 지원

Vocal Shortcuts를 사용하면 Siri가 특정 작업을 수행할 수 있는 사용자 정의 발언을 할당할 수 있습니다.

또한 비정상적인 발음을 인식하는 기능은 뇌성 마비 또는 ALS와 같은 상태를 가진 사용자들을 위해 향상된 음성 인식을 제공하기 위해 기계 학습을 사용합니다.

(제공: 애플)

차량 운동 힌트와 CarPlay 개선 사항

운동 멀미 감소 및 접근성 향상

차량 운동 힌트는 차량 운동을 나타내는 애니메이션 점을 표시하여 감각적인 충돌을 최소화하여 운동 멀미를 줄일 수 있습니다.

CarPlay 업데이트에는 음성 제어, 색상 필터, 그리고 소리 인식이 포함되어 운전 경험을 모든 사용자에게 더 안전하고 접근 가능하게 만듭니다.

visionOS용 접근성 기능

Apple Vision Pro에 대한 향상된 기능

visionOS는 청각 장애 또는 난청인 사용자들을 지원하는 시스템 전체적인 라이브 캡션을 도입할 예정입니다.

추가 기능으로는 투명도 줄이기, 스마트 반전, 그리고 발광 라이트 감소가 있으며 시각 장애 또는 밝은 빛에 민감한 사용자를 위해 제공됩니다.![]()

(제공: 애플)

편집자의 코멘트

애플의 접근성에 대한 약속은 이런 획기적인 기능들에서 명백합니다.

인공 지능과 기계 학습을 활용하여 애플은 포용적인 디자인의 경계를 계속 넓혀나가고 있습니다.

이러한 업데이트는 사용자 경험을 향상시키는 데 뿐만 아니라 기술의 접근성에 대한 새로운 기준을 제시합니다.